Infiltración con Deepfakes: La Nueva Era de los Ataques APT Norcoreanos

Análisis técnico de las campañas de infiltración laboral de Famous Chollima usando IA generativa, identidades sintéticas y suplantación avanzada contra la industria financiera y tecnológica global

Resumen Ejecutivo

Desde AcaciaSec

Estamos comprometidos con el análisis profundo de este tipo de ataques sofisticados y la difusión de conocimiento sobre amenazas persistentes avanzadas (APT). Nuestro objetivo es alertar a la comunidad de ciberseguridad sobre las tácticas, técnicas y procedimientos emergentes, así como colaborar activamente con cualquier organismo, entidad o empresa que requiera asesoría, evaluación de seguridad o soporte especializado en la protección contra estas amenazas. La prevención y respuesta efectiva ante actores maliciosos requiere cooperación y transparencia en el intercambio de inteligencia de amenazas.

El Contexto del Ataque

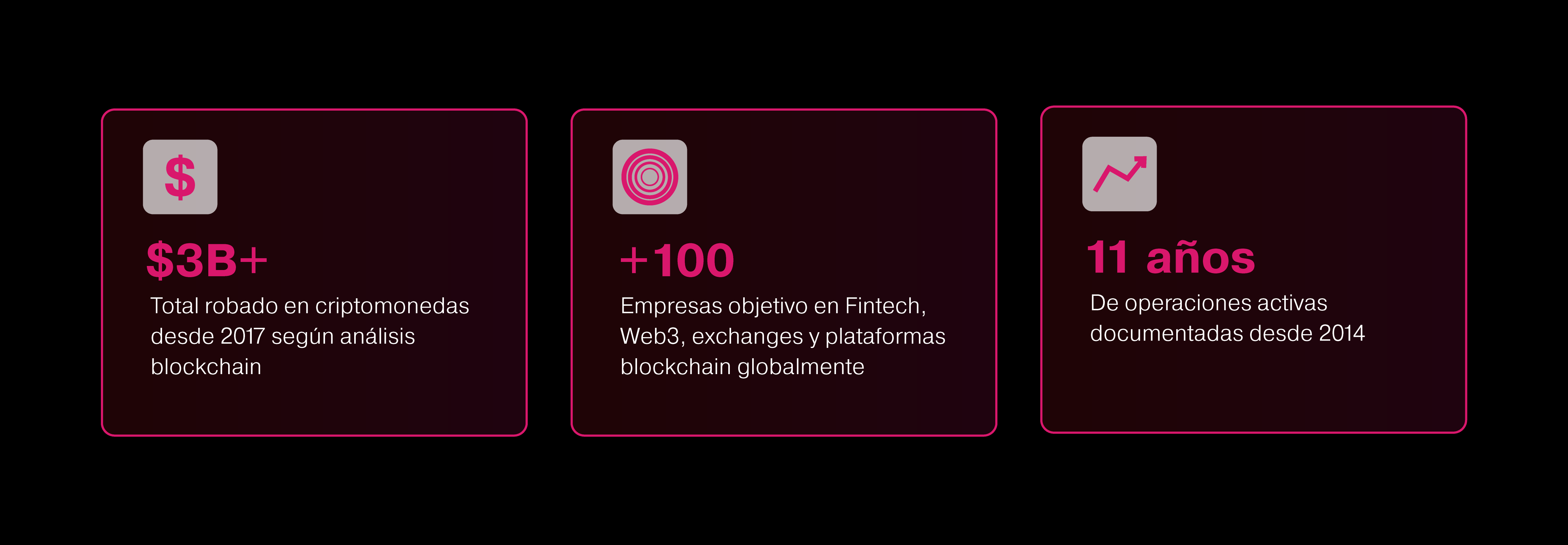

El grupo Famous Chollima, también conocido como APT38 y parte del ecosistema Lazarus Group, es una división de élite de ciberataques respaldada por el gobierno de Corea del Norte (DPRK). Su objetivo principal es generar ingresos para el régimen sancionado mediante robo de criptomonedas, infiltración en organizaciones financieras y espionaje corporativo.

Desde su identificación inicial en 2014, este grupo ha sido responsable de algunos de los robos de criptoactivos más grandes de la historia. Su modus operandi ha evolucionado constantemente, adaptándose a las defensas mejoradas de las organizaciones objetivo y aprovechando las últimas tecnologías disponibles. Lo que distingue a Famous Chollima de otros grupos APT es su enfoque híbrido: combinan ataques técnicos sofisticados con ingeniería social avanzada y, más recientemente, el uso de inteligencia artificial generativa.

Incidentes Documentados de Lazarus Group / Famous Chollima

El historial de ataques de Lazarus Group y su división Famous Chollima es extenso y devastador. Estos son algunos de los incidentes más significativos documentados por agencias de inteligencia internacionales:

2022 - Ronin Network - $625 millones robados

El ataque más grande en la historia de DeFi. Los atacantes comprometieron 5 de 9 validadores de la red Ronin (usada por el juego Axie Infinity), permitiendo la extracción de 173,600 ETH y $25.5M USDC. El FBI atribuyó oficialmente el ataque a Lazarus Group.

2021-2023 - Campaña Global de Infiltración Laboral

El FBI y CISA documentaron cientos de casos de trabajadores IT norcoreanos infiltrados en empresas tecnológicas de EE.UU., Europa y Asia. Los objetivos incluían acceder a código propietario, sistemas internos y generar ingresos legítimos para el régimen. Empresas afectadas incluyen Fortune 500 del sector tecnológico, blockchain y finanzas.

2024 - PlayDapp - $290 millones comprometidos

Ataque a la plataforma blockchain de gaming PlayDapp donde se mintieron tokens PLA no autorizados. El atacante explotó vulnerabilidades en contratos inteligentes para generar 1.79 mil millones de tokens PLA. Blockchain analytics vincularon las wallets con infraestructura conocida de Lazarus.

2023 - Atomic Wallet - $100 millones robados

Compromiso masivo de usuarios de Atomic Wallet, donde más de 5,500 wallets fueron drenadas de sus fondos. El ataque involucró comprometer la infraestructura de la wallet, permitiendo extracción de claves privadas. Elliptic y otras firmas de análisis blockchain confirmaron vínculos con Lazarus.

2024-2025 - Ataques con Deepfakes en Procesos de Hiring

Múltiples empresas fintech y crypto exchanges reportaron intentos de infiltración donde candidatos usaron deepfakes durante videollamadas de entrevistas. Los casos documentados incluyen exchanges latinoamericanos, europeos y asiáticos. Esta táctica representa la última evolución en las campañas de infiltración laboral del grupo.

La Amenaza Global de Lazarus Group

Lazarus Group no es simplemente un colectivo de hackers: es una operación de cibercrimen patrocinada por un estado con objetivos geopolíticos y financieros claros. Las sanciones internacionales contra Corea del Norte han limitado severamente sus fuentes de ingresos legítimas, lo que ha obligado al régimen a buscar alternativas creativas para financiar sus operaciones gubernamentales y su programa de armas nucleares.

Según estimaciones del FBI y agencias de inteligencia internacionales, Lazarus Group ha robado más de $3 mil millones de dólares en criptomonedas desde 2017. Estos fondos son canalizados directamente al gobierno norcoreano, financiando aproximadamente el 40% de su programa de misiles balísticos según analistas de seguridad internacional.

¿Por qué las Empresas Fintech y Crypto son Objetivos?

Las empresas del sector fintech, exchanges de criptomonedas y plataformas blockchain representan objetivos de alto valor para grupos como Famous Chollima. Las razones son múltiples:

- Alto Volumen de Activos: Estas organizaciones custodian y procesan millones o miles de millones de dólares en criptomonedas, representando objetivos financieramente lucrativos.

- Infraestructura Crítica: Acceso a sistemas de trading, hot wallets, cold storage y bases de datos de usuarios puede ser explotado para múltiples vectores de ataque.

- Naturaleza Descentralizada: Las transacciones blockchain son irreversibles, haciendo que los fondos robados sean extremadamente difíciles de recuperar una vez movidos.

- Innovación Tecnológica: La propiedad intelectual, arquitectura de sistemas y prácticas de seguridad tienen valor de espionaje industrial y pueden ser reutilizadas en futuras operaciones.

- Regulación Variable: Diferentes jurisdicciones tienen diferentes niveles de regulación y supervisión, creando oportunidades para explotar gaps en compliance y seguridad.

El Cambio de Paradigma: Deepfakes en Recursos Humanos

Tradicionalmente, los equipos de seguridad se han enfocado en proteger la infraestructura técnica: firewalls, sistemas de detección de intrusiones, monitoreo de red, y respuesta a incidentes. Sin embargo, los recientes ataques de Famous Chollima exponen una vulnerabilidad crítica que muchas organizaciones han subestimado: el proceso de contratación.

Los departamentos de Recursos Humanos raramente reciben entrenamiento en detección de amenazas APT. Los reclutadores están capacitados para evaluar habilidades técnicas, ajuste cultural y experiencia profesional, no para identificar deepfakes o técnicas avanzadas de suplantación de identidad. Esta brecha representa una superficie de ataque completamente nueva que Famous Chollima está explotando activamente en múltiples organizaciones globalmente.

Lo que hace particularmente peligroso este vector es que la barrera de entrada ha disminuido drásticamente. Hace apenas dos años, crear deepfakes convincentes en tiempo real requería hardware especializado, equipos de expertos y presupuestos significativos. Hoy, con herramientas de IA generativa ampliamente disponibles, un actor malicioso con conocimientos moderados puede generar videos sintéticos con un laptop de gama media y software de código abierto.

Análisis Técnico: Indicadores de Compromiso

Los equipos de seguridad y reclutamiento de organizaciones afectadas han identificado múltiples IoCs (Indicators of Compromise) que revelan la naturaleza sintética de las identidades utilizadas en estas campañas. A continuación, un análisis detallado de cada indicador y su significado técnico basado en múltiples casos documentados.

Cronología Típica de Detección

Indicadores Técnicos Identificados

Movimientos Faciales Anómalos

Sincronización deficiente entre movimiento labial y habla detectada durante videollamadas

Latencia de 100-300ms en renderizado facial GAN debido a procesamiento en tiempo real

Los modelos de face-swapping necesitan procesar cada frame del video antes de transmitirlo, generando un retraso perceptible entre el audio y el movimiento labial. Este retraso es especialmente notable en palabras con consonantes explosivas (p, t, k) donde la desincronización es más evidente.

Artefactos Digitales Visibles

Dientes estáticos, parpadeo irregular y "suturas digitales" en bordes faciales

Limitaciones en modelos de face-swapping en tiempo real basados en StyleGAN2/3

Los algoritmos actuales de deepfake tienen dificultad para mantener consistencia en elementos faciales detallados como dientes individuales, textura de la piel y bordes entre el rostro y el fondo. Bajo iluminación variable o con movimientos rápidos de cabeza, estos artefactos se vuelven más pronunciados.

Discrepancias Geográficas y Lingüísticas

CV mexicano (Jalisco/Chihuahua) sin capacidad de comunicarse en español

Fallo en ingeniería social y preparación del perfil de cobertura

Los atacantes robaron identidades de ingenieros mexicanos reales pero no pudieron replicar competencia lingüística. Cuando se les solicitó hablar en español, evadían con excusas técnicas o afirmaban problemas de conexión. Esta inconsistencia básica fue una red flag inmediata para el equipo de reclutamiento.

Perfiles LinkedIn EfímerosAlto

Cuentas sociales eliminadas inmediatamente tras la detección del ataque

Infraestructura de atribución preparada para eliminación rápida y difusión de evidencia

Una vez que Bitso identificó el intento de infiltración, los perfiles de LinkedIn, GitHub y otras redes sociales asociados desaparecieron en cuestión de horas. Esto sugiere un protocolo operacional establecido para minimizar atribución y análisis forense post-incidente.

Tecnologías de Deepfake Utilizadas

Basándonos en el análisis de múltiples incidentes y colaboración con expertos en detección de medios sintéticos, se han identificado las siguientes tecnologías probables utilizadas por los atacantes:

Face-Swapping en Tiempo Real

-Descripción: Tecnología para intercambiar rostros en video streaming sin latencia perceptible

-Desafíos Técnicos:Mantener consistencia en múltiples frames, iluminación variable, y ángulos de cámara

-Métodos de Detección:Análisis de parpadeo, micro-expresiones y coherencia temporal entre frames

Voice Cloning / Text-to-Speech

Descripción:Síntesis de voz que imita patrones de habla y tonalidad de personas reales

Desafíos Técnicos:Replicar emociones naturales, respiración, y variaciones de tono orgánicas

Métodos de Detección:Análisis espectral de audio, detección de artefactos sintéticos en frecuencias

Manipulación de Video en Pipeline

Descripción:Procesamiento de video en tiempo real para aplicar filtros y modificaciones durante transmisión

Desafíos Técnicos:Mantener calidad sin introducir artifacts visibles o degradación de imagen

Métodos de Detección:Análisis de compresión anómala, patrones de ruido inconsistentes

Stack Tecnológico Probable del Atacante

- GANs para Face-Swapping: Modelos generativos adversariales de intercambio facial en tiempo real, posiblemente basados en arquitecturas StyleGAN2/StyleGAN3 o frameworks como DeepFaceLab, First Order Motion Model (FOMM), o sistemas propietarios desarrollados internamente

- Voice Cloning/TTS Avanzado: Sistemas de síntesis de voz para mantener coherencia en comunicaciones de audio. Tecnologías como Tacotron 2, WaveNet, o servicios comerciales de clonación de voz que requieren solo 30-60 segundos de audio de muestra

- Video Manipulation Pipelines: Filtros y procesamiento ML para streaming de video manipulado en plataformas como Zoom, Microsoft Teams o Google Meet. Posiblemente utilizando virtual camera drivers (OBS Virtual Camera, ManyCam) para inyectar video procesado en el stream

- Infraestructura de Soporte: Servidores con GPUs de alto rendimiento (probablemente NVIDIA RTX 3090/4090 o superior) para procesamiento en tiempo real, VPNs para enmascarar ubicación geográfica, y sistemas de gestión de identidades falsas para crear perfiles sociales convincentes

¿Por qué estos deepfakes no son perfectos?

A pesar de los avances en IA generativa, crear deepfakes completamente convincentes en tiempo real sigue siendo técnicamente desafiante:

- Limitaciones de Hardware: El procesamiento en tiempo real requiere compromisos entre calidad y latencia. Los atacantes priorizan baja latencia sobre perfección visual.

- Complejidad de Micro-expresiones: Las expresiones faciales humanas involucran 43 músculos. Replicar todas las sutilezas en tiempo real es computacionalmente prohibitivo.

- Coherencia Temporal: Mantener consistencia entre frames consecutivos mientras se adapta a iluminación cambiante y movimientos impredecibles es extremadamente difícil.

Modalidad del Ataque: Modus Operandi Detallado

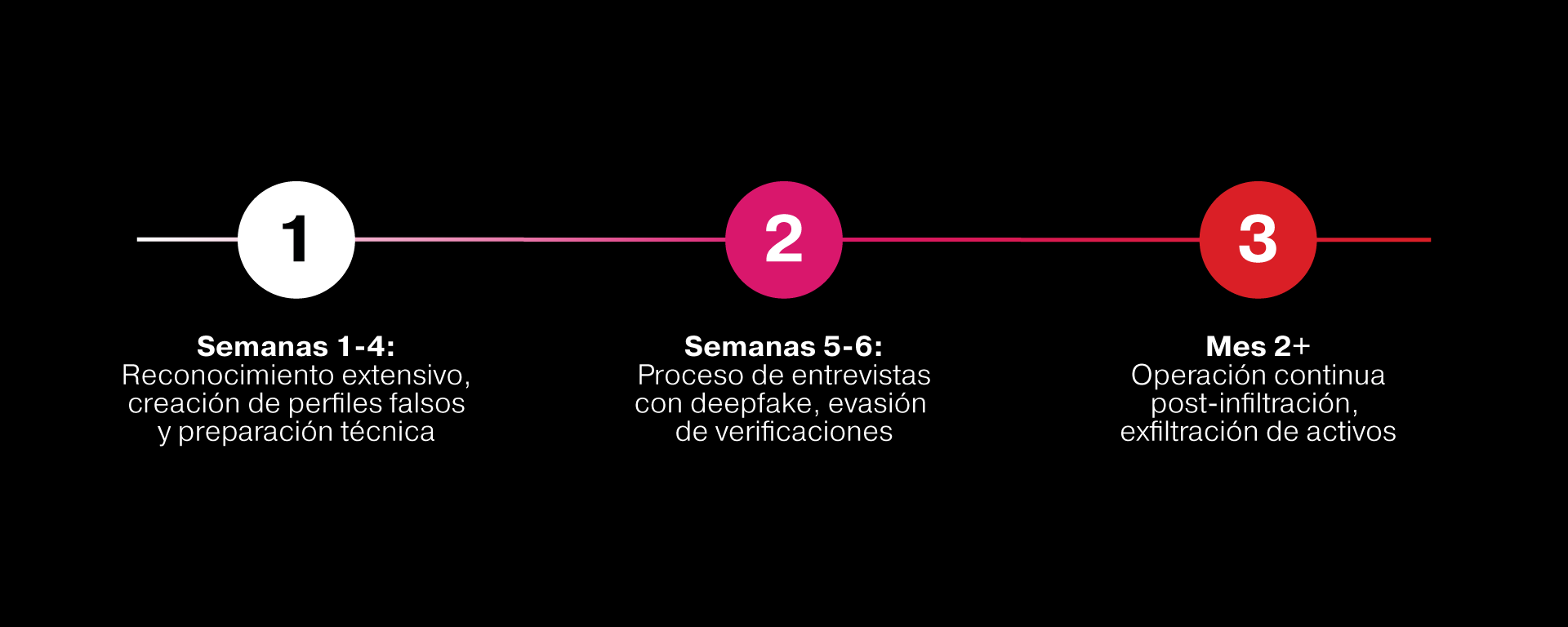

El ataque siguió un patrón metodológico sofisticado en tres fases distintas, cada una diseñada para evadir capas específicas de controles de seguridad tradicionales y explotar la confianza inherente en los procesos de recursos humanos.

Contexto Operacional

Este tipo de ataque representa un cambio fundamental en la estrategia de actores APT patrocinados por estados. En lugar de intentar penetrar sistemas desde el exterior mediante exploits técnicos (que son cada vez más difíciles debido a mejores prácticas de seguridad), los atacantes están optando por la "puerta principal": convertirse en empleados legítimos.

Esta aproximación tiene ventajas significativas para el atacante: acceso autorizado desde el primer día, menor sospecha de actividades anómalas (nuevos empleados naturalmente exploran sistemas), y la capacidad de mantener presencia persistente durante meses o incluso años. El uso de deepfakes añade una capa adicional de sofisticación que hace estos ataques particularmente difíciles de detectar sin entrenamiento específico.

Fase 1 - Reconocimiento y Preparación

- Identificación de empresas objetivo mediante análisis de noticias financieras, rondas de inversión y crecimiento de mercado (Fintech, Crypto, Web3, DeFi)

- Scraping automatizado de perfiles de LinkedIn, GitHub y portales de empleo para recolectar CVs reales de ingenieros en México y LATAM

- Análisis detallado de tecnologías utilizadas por la empresa objetivo (stack técnico, frameworks, arquitectura) para preparar respuestas creíbles en entrevistas

- Robo de fotografías e información biográfica de ingenieros reales para crear perfiles de cobertura convincentes

- Creación de perfiles falsos en LinkedIn con conexiones fabricadas y endorsements automatizados para simular legitimidad

- Configuración de infraestructura técnica: servidores con GPUs, software de deepfake, VPNs y virtual cameras

Fase 2 - Infiltración y Engagement

- Aplicación masiva a posiciones de Software Engineer Senior, DevOps, Security Engineer y roles con acceso privilegiado

- Comunicación inicial por email y Slack/Discord usando texto cuidadosamente redactado para evitar inconsistencias lingüísticas

- Primera videollamada de screening utilizando deepfake en tiempo real con rostro sintético superpuesto sobre operador real

- Evasión de preguntas sobre ubicación geográfica con excusas como 'trabajo remoto desde el extranjero' o 'nómada digital'

- Intentos de acelerar el proceso de contratación alegando 'otras ofertas pendientes' o 'disponibilidad inmediata'

- Si se solicita prueba de identidad, envío de documentos falsificados (INE/pasaporte manipulado digitalmente)

- Resistencia a videoconferencias improvisadas o con requisitos específicos de movimiento facial

Fase 3 - Objetivos Post-Infiltración (Si tuviera éxito)

- Acceso inicial a sistemas de producción, repositorios de código privados y documentación interna sensible

- Establecimiento de backdoors persistentes en servidores críticos y mecanismos de autenticación

- Exfiltración gradual de propiedad intelectual: algoritmos propietarios, estrategias de trading, datos de clientes

- Robo de claves privadas de wallets institucionales y credenciales de exchanges para facilitar transferencias no autorizadas

- Reconocimiento interno de arquitectura de seguridad para planificar ataques secundarios más sofisticados

- Lavado de fondos robados hacia cuentas controladas por el régimen norcoreano mediante mixers y cadenas complejas

- Potencial venta de acceso a otros actores maliciosos en mercados underground (Initial Access Brokers)

Visualización del Flujo de Ataque

Fase 1: Reconocimiento

Identificación de empresas objetivo (Fintech/Crypto)Scraping de perfiles LinkedIn y GitHubRobo de identidades y fotografías realesConfiguración de infraestructura deepfake

Fase 2: Infiltración

Aplicación a posiciones Senior EngineeringVideollamadas con deepfake en tiempo realEvasión de verificación de ubicación/idiomaDocumentos de identidad falsificados

Fase 3: Explotación (Objetivo Final)

Acceso a sistemas de producción y repositoriosInstalación de backdoors persistentesExfiltración de claves privadas y datos sensiblesRobo de criptoactivos y lavado de fondos

Activos de Alto Valor Objetivo

Una vez dentro de la organización, los atacantes buscarían acceder sistemáticamente a los siguientes tipos de información crítica:

-Datos Objetivo: Bases de datos de usuarios, transacciones, KYC/AML, claves privadas de wallets calientes

-Infraestructura: Diagramas de red, configuraciones de servidores, credenciales de AWS/GCP/Azure

-Código Fuente: Repositorios privados con algoritmos de trading, sistemas de seguridad, APIs internas

-Inteligencia Corporativa: Estrategias de negocio, roadmaps de productos, información M&A, contratos con partners

Impacto Potencial si el Ataque Hubiera Tenido Éxito

Las consecuencias de una infiltración exitosa habrían sido devastadoras no solo para Bitso, sino potencialmente para todo el ecosistema de criptomonedas en América Latina. Los daños estimados incluyen:

- Pérdidas Financieras Directas: Potencial robo de millones de dólares en criptoactivos de wallets calientes y manipulación de transacciones

- Compromiso de Datos de Usuarios: Exposición de información KYC/AML de millones de usuarios latinoamericanos, incluyendo documentos de identidad, datos bancarios y historial de transacciones

- Daño Reputacional Irreparable: Pérdida masiva de confianza del cliente en exchanges latinoamericanos, potencialmente retrasando la adopción de cripto en la región por años

- Consecuencias Regulatorias: Sanciones de autoridades financieras mexicanas y regionales, posible suspensión de licencias operativas

- Espionaje Industrial: Robo de propiedad intelectual que podría beneficiar a competidores o ser vendida en mercados underground

- Efecto Dominó en el Ecosistema: Compromiso potencial de partners, exchanges conectados y servicios integrados que confían en la infraestructura de Bitso

Lecciones del Caso Ronin Network

Para entender la magnitud del riesgo, es útil revisar el caso de Ronin Network en 2022, donde Lazarus Group (la organización madre de Famous Chollima) robó $625 millones de dólares en uno de los mayores robos de criptomonedas de la historia.

En ese caso, los atacantes también utilizaron ingeniería social sofisticada, pero combinada con exploits técnicos. El ataque a Bitso mediante infiltración laboral con deepfakes representa una evolución de esa estrategia, potencialmente más efectiva porque no requiere encontrar vulnerabilidades técnicas complejas: solo necesita engañar a humanos durante el proceso de contratación.

Recomendaciones de Seguridad Detalladas

Medidas prácticas, implementables y específicas para proteger tu organización y tus datos personales contra ataques de identidad sintética y infiltración laboral con deepfakes.

Para Equipos de Recursos Humanos y Talent Acquisition

Prioridad Alta

-Verificación Biométrica Avanzada:

Implementar herramientas de detección de deepfakes durante todas las entrevistas en video. Soluciones como Microsoft Video Authenticator, Sensity AI o Intel FakeCatcher pueden analizar micro-expresiones, patrones de parpadeo y consistencia facial en tiempo real.

Implementación Práctica: Integrar API de detección en plataforma de videollamadas (Zoom, Teams). Configurar alertas automáticas para scores de autenticidad < 70%.

Validación Lingüística Espontánea y Cultural

Realizar preguntas improvisadas en el idioma nativo del candidato según su ubicación declarada. No solo verificar el idioma, sino modismos locales, referencias culturales y conocimiento geográfico específico que sería difícil falsificar.

Implementación Práctica: Crear banco de preguntas culturales por región. Ejemplo: 'Describe tu ruta diaria al trabajo anterior' o '¿Cuál es tu taquería favorita cerca de tu casa?'

Background Checks Exhaustivos con Verificación Directa

No confiar únicamente en referencias proporcionadas por el candidato. Validación directa con instituciones educativas (registros de la universidad), empleadores anteriores (llamar a RRHH corporativo, no al contacto proporcionado), y verificación de documentos gubernamentales con autoridades.

Implementación Práctica: Contratar servicio de verificación de antecedentes de nivel 3 que incluya validación de documentos con autoridades mexicanas (CURP, RFC, INE) y verificación internacional de estudios.

Protocolo de Cámara Obligatoria con Pruebas de Vivacidad

Requerir video en vivo desde el primer contacto. Solicitar movimientos faciales específicos como 'voltea a la izquierda', 'sonríe ampliamente', 'parpadea tres veces seguidas' para verificar que no es video pre-grabado o deepfake de baja calidad.

Implementación Práctica: Estandarizar secuencia de verificación: 1) Mostrar documento de identidad a cámara, 2) Realizar movimientos solicitados, 3) Responder pregunta improvisada en idioma nativo.

Análisis de Consistencia de Información

Validar consistencia entre CV, perfil de LinkedIn, GitHub, portafolio personal y respuestas en entrevista. Buscar inconsistencias temporales (fechas que no coinciden), geográficas (ubicaciones que se contradicen) o técnicas (experiencia declarada vs conocimientos demostrados).

Implementación Práctica: Crear checklist de verificación cruzada: antigüedad en LinkedIn vs CV, commits de GitHub vs experiencia declarada, zona horaria de actividad en redes vs ubicación declarada.

Red Flags de Ingeniería Social

Entrenar reclutadores para identificar señales de advertencia: presión para acelerar proceso, evasión de preguntas personales, inconsistencias lingüísticas, resistencia a verificaciones adicionales, perfiles sociales muy nuevos o con poca actividad histórica.

Implementación Práctica: Capacitación trimestral obligatoria sobre amenazas APT y técnicas de ingeniería social. Simulacros con candidatos falsos para practicar detección.

Para Equipos de Ciberseguridad e InfoSec

Prioridad Crítica

Despliegue de Herramientas Anti-Deepfake

Implementar soluciones de detección en pipelines de reclutamiento. Microsoft Video Authenticator utiliza modelos ML para detectar manipulación en boundaries faciales. Sensity AI ofrece APIs para análisis en tiempo real. Intel FakeCatcher analiza flujo sanguíneo facial mediante fotopletismografía remota (PPG).

Implementación Práctica: POC de 3 soluciones en paralelo durante 30 días. Medir tasa de falsos positivos. Seleccionar solución con mejor balance precisión/UX. Integrar en Zoom/Teams via webhook.

Threat Intelligence Compartida y Activa

Suscripción a feeds de inteligencia sobre Famous Chollima, Lazarus Group, APT38 y otros actores norcoreanos. Monitoreo de indicadores de compromiso (IoCs): dominios utilizados, patrones de email, características de perfiles falsos, TTP actualizados.

Implementación Práctica: Integrar feeds de MITRE ATT&CK, AlienVault OTX, FBI IC3, CISA. Configurar alertas en SIEM para IoCs conocidos. Participar en grupos de información compartida (ISACs) de sector fintech/crypto.

Arquitectura Zero Trust para Nuevos Empleados

Implementar segmentación estricta de accesos durante período de prueba extendido (90-180 días). Nuevos empleados operan en entornos sandbox con acceso limitado a sistemas críticos. Monitoreo exhaustivo de actividades: comandos ejecutados, archivos accedidos, transferencias de datos.

Implementación Práctica: Crear tier de permisos 'Junior Access' automático para primeros 90 días. Requiere aprobación de 2 managers para acceso a producción, claves privadas o datos sensibles. Alertas ML sobre comportamiento anómalo.

Monitoreo de Anomalías Geográficas y Comportamentales

Alertas automáticas para solicitudes de empleo con inconsistencias: ubicación de IP vs ubicación declarada, zona horaria de actividad inconsistente, múltiples aplicaciones desde misma IP/fingerprint, uso de VPNs comerciales en proceso de aplicación.

Implementación Práctica: Implementar fingerprinting avanzado en portal de aplicaciones. Correlacionar con threat intel sobre IPs/ASNs asociados a DPRK. Scoring automático de riesgo por candidato.

Programa de Bug Bounty Interno para Detección de Infiltración

Incentivar a empleados actuales a reportar comportamientos sospechosos de colegas: acceso anómalo a sistemas, preguntas inusuales sobre arquitectura, intentos de obtener credenciales, comportamiento antisocial que podría indicar actor malicioso.

Implementación Práctica: Canal confidencial de reporte (no necesariamente anónimo para evitar abuso). Bonos por reportes legítimos. Investigación discreta por Security Operations Center (SOC) sin alertar a sospechoso.

Honeypots en Proceso de Onboarding

Crear sistemas 'falsos' con datos sintéticos atractivos accesibles a nuevos empleados. Cualquier acceso a estos sistemas dispara alerta inmediata. Permite detectar actores maliciosos sin riesgo de compromiso real.

Implementación Práctica: Configurar repositorio de código con 'claves API' falsas pero realistas. Base de datos con 'datos de usuarios' sintéticos. Wallet con 'balance alto' en testnet. Monitoreo 24/7 de accesos.

Para Protección de Identidad Personal

Prioridad Media

Monitoreo Activo de Identidad Digital

Configurar Google Alerts para tu nombre completo y variantes en combinación con términos profesionales. Buscar: "[Tu Nombre] ingeniero", "[Tu Nombre] curriculum", "[Tu Nombre] Bitso/empresa". Configurar alertas semanales.

Implementación Práctica: Crear 5-10 alertas de Google con variaciones de tu nombre + títulos profesionales. Usar herramientas como Talkwalker Alerts como backup. Revisar resultados semanalmente.

Búsqueda Inversa de Imágenes Periódica

Usar Google Images, TinEye, Yandex Images para verificar uso no autorizado de tus fotografías. Los atacantes frecuentemente roban fotos de perfiles de LinkedIn, GitHub, Twitter para crear identidades falsas.

Implementación Práctica: Búsqueda mensual de foto de perfil principal. Si encuentras uso no autorizado: 1) Screenshot como evidencia, 2) Reportar a plataforma, 3) Notificar a tu empleador si es perfil laboral falso.

Limitar Información Pública en Perfiles Profesionales

Reducir detalles específicos que faciliten suplantación: no publicar CV completo con todas las fechas exactas, limitar detalles de proyectos que podrían ser replicados, evitar compartir documentos con información personal visible (certificados con números de identificación).

Implementación Práctica: Auditar perfiles de LinkedIn, GitHub, portafolio personal. Remover: teléfono personal completo (usar versión parcial), dirección exacta (solo ciudad), fechas exactas de nacimiento, documentos oficiales escaneados.

Reportar Perfiles Duplicados Inmediatamente

Si detectas perfil de LinkedIn, GitHub o cualquier red que suplante tu identidad, reportar inmediatamente usando procesos oficiales de la plataforma. LinkedIn tiene formulario específico para identity theft. GitHub puede suspender cuentas por impersonation.

Implementación Práctica: Documentar evidencia: screenshots, URLs, timestamps. Reportar a plataforma mediante formulario oficial. Si perfil está aplicando a empleos, notificar directamente a empresas objetivo. Considerar reporte a autoridades si hay intento de fraude financiero.

Watermarking de Documentos Profesionales

Agregar marcas de agua discretas a CVs, cartas de presentación y portafolios digitales que permitan rastrear uso no autorizado. Incluir metadata personalizada en PDFs.

Implementación Práctica: Usar herramientas como Adobe Acrobat para agregar watermark invisible o metadata custom. Crear versiones únicas de CV para cada aplicación con código de tracking en footer (texto blanco sobre blanco solo visible en selección).

Configurar Autenticación Multifactor en Todas las Cuentas Profesionales

Proteger cuentas de LinkedIn, GitHub, email profesional con MFA robusto (preferiblemente hardware keys como YubiKey). Si atacante compromete tu cuenta, puede usarla para aplicar a empleos como 'tú'.

Implementación Práctica: Activar MFA en: LinkedIn, GitHub, GitLab, correo personal, Google account, iCloud. Usar autenticator apps (Authy, 1Password) o hardware keys. Deshabilitar recuperación por SMS (vulnerable a SIM swapping).

Herramientas de Detección de Deepfakes

- Microsoft Video Authenticator

- Intel FakeCatcher

- Reality Defender

- Sensity AI

- Deepware Scanner

Recursos de Entrenamiento Recomendados

- SANS SEC504: Hacker Tools, Techniques, and Incident Handling - Incluye módulos sobre social engineering y APT tactics

- Cybrary APT Fundamentals: Curso gratuito sobre Advanced Persistent Threats y threat actor profiling

- CISA Insider Threat Training: Programa gubernamental sobre detección de amenazas internas (aplicable a infiltración laboral)

- Deepfake Detection Challenge (Kaggle): Datasets y notebooks para entrenar modelos de detección propios

Conclusiones Clave

Lecciones aprendidas y perspectivas sobre el futuro de las amenazas sintéticas

La IA Democratiza Amenazas APT

Lo que antes requería recursos estatales masivos ahora está disponible con software comercial y modelos de código abierto

Evolución Más Rápida que las Defensas

La ingeniería social potenciada por IA evoluciona exponencialmente más rápido que los controles de seguridad tradicionales

Ningún Sector Está Seguro

Los ataques se expanden de crypto/fintech a arquitectura, ingeniería civil, defensa y otros sectores críticos

Colaboración Interdepartamental Crítica

La defensa efectiva requiere coordinación estrecha entre RRHH, Ciberseguridad, Legal y Operaciones

Perspectiva Final

El caso de Famous Chollima III representa un punto de inflexión en la ciberseguridad corporativa. Los deepfakes en tiempo real ya no son ciencia ficción ni herramientas exclusivas de actores estatales con recursos ilimitados.

La IA generativa ha nivelado el campo de juego, permitiendo que grupos APT ejecuten ataques sofisticados a escala industrial. La detección de Bitso demuestra que la defensa efectiva requiere:

- •Educación continua de equipos sobre amenazas emergentes

- •Inversión en herramientas de detección de última generación

- •Protocolos de verificación multicapa en procesos críticos

- •Cultura de seguridad que no confía ciegamente en las apariencias

El mensaje es claro: en la era de las identidades sintéticas, verificar es más importante que confiar.

Referencias y Lecturas Adicionales

• MITRE ATT&CK: APT38 / Lazarus Group Tactics, Techniques & Procedures

• FBI IC3: North Korean IT Workers Identity Theft Alert (2024-2025)

• CISA Advisory: DPRK Cyber Threats to Critical Infrastructure

• Bitso Quetzal: Interview with the Chollima III - Caso de estudio original

• Chainalysis: Crypto Crime Report - North Korean Threat Actors